GPT-4 Omniによる一貫したキャラクター作成:機能の探索

GPT-4 Omniの強力な機能を探索してください。OpenAIの最新のAIモデルであるGPT-4 Omniは、リアルタイムのやり取りでオーディオ、ビジョン、テキストを seamlessly に統合できます。開発者やコンテンツクリエイターにとってゲームチェンジャーとなる、その速度、コスト効率、および複数のシーンにわたって一貫したキャラクターを作成する能力を発見してください。

2025年4月3日

AIの最新の進歩、GPT-4 Omniの発売を含め、人間とコンピューターの相互作用を革新し、一貫性のある魅力的なデジタル体験を生み出す新しい可能性を開いています。このブログ記事では、この最先端の技術の機能と、さまざまな業界への潜在的な影響について探ります。

GPT-4 Omniの機能の探索

GPT-4 Omniの価格設定と費用対効果

モデルの評価とベンチマーキング

言語トークン化と表現

GPT-4 Omniの安全性と制限

GPT-4 Omniの入手可能性とアクセス

GPT-4 Omniによる一貫したキャラクター作成

結論

GPT-4 Omniの機能の探索

GPT-4 Omniの機能の探索

OpenAIが最近リリースしたGPT-4 Omniは、リアルタイムで音声、視覚、テキストを横断的に処理できる強力なモデルを導入しました。この新しいモデルには以下のような印象的な機能があります:

-

マルチモーダルな対話: GPT-4 Omniはテキスト、音声、画像、動画の入力を受け付け、これらのモダリティの組み合わせで出力を生成できます。これにより、より自然なヒューマン・コンピューター対話が可能になります。

-

高速な応答: このモデルは平均232ミリ秒以内に音声入力に応答できるため、人間の会話速度に匹敵します。

-

性能の向上: GPT-4 Omniは、テキスト評価、音声ASR、音声翻訳などの様々なベンチマークで前モデルを上回る成績を収めています。

-

コスト効率: 新しいモデルはGPT-4 Turboの50%安価で、APIユーザーにとってより手頃な価格になっています。ChatGPTの無料版がGPT-4 Omniを使用するようになり、その機能をより多くのユーザーが利用できるようになりました。

GPT-4 Omniの価格設定と費用対効果

GPT-4 Omniの価格設定と費用対効果

GPT-4 Omniの発表により、前モデルと比べて価格と費用対効果が大幅に改善されました。主な特徴は以下の通りです:

- トークン1,000個あたりの入力コストが$0.01から$0.005に下がりました。

- トークン1,000個あたりの出力コストが$0.03から$0.015に下がりました。

- 視覚処理の価格も大幅に安くなり、GPT-4 Omniの総合的な使用コストが低減されました。

- GPT-3.5 Turboと比べて50%安くなり、開発者やユーザーにとってより手頃な選択肢になりました。

- ChatGPTの無料版がGPT-4 Omniモデルを使用するようになり、より多くのユーザーがその改善された機能と性能を無料で利用できるようになりました。

- これらの価格変更により、GPT-4 Turboを使う理由はほとんどなくなり、GPT-4 Omniの方が優れた性能とコスト効率を提供します。

モデルの評価とベンチマーキング

モデルの評価とベンチマーキング

OpenAIは新しいGPT-4 Omniモデルをさまざまなベンチマークテストに掛けて性能を評価しました。このモデルはGPT-4 Turbo、オリジナルのGPT-4、Claude 3、Opus Gemini Pro 1.5、Gemini 1.0、LLaMA 3などの他の言語モデルと比較されました。

その結果、GPT-4 Omniはほとんどすべてのテストカテゴリーで他のモデルを上回る成績を収めました:

- テキスト評価: GPT-4 Omniが最高得点を達成しました。

- 音声ASR(自動音声認識): GPT-4 Omniは前のWhisper version 3モデルよりも誤り率が低い成績を収めました。

- 音声翻訳: GPT-4 Omniが他のすべてのモデルを上回りました。

- M3 Exam Zero-Shot: GPT-4 OmniがオリジナルのGPT-4モデルを上回りました。

- 視覚理解評価: GPT-4 Omniがこれらのテストで最高得点を達成しました。

記事では、GPT-4 Omniの言語トークン化機能の向上がコスト効率につながっていると述べています。英語のトークン数が1.1倍しか減少していないものの、大量のテキストに適用すれば大きな節約になります。

言語トークン化と表現

言語トークン化と表現

記事によると、GPT-4 Omniが安価な理由の1つは、言語をより少ないトークンで表現できることです。英語のトークン数は1.1倍しか減少していませんが、数十万語規模のテキストに適用すれば大きな節約につながります。

記事では、以前27トークンだった完全な文が今は24トークンになったと説明しています。この言語トークン化と表現の改善により、GPT-4 Omniはトークンの使用をより効率的に行えるようになり、前モデルと比べて50%のコスト削減につながったと述べています。

記事は、この強化された言語モデリング機能がGPT-4 Omniをより費用対効果の高い選択肢にしていると指摘しています。特に、大量のテキストを複数の言語にわたって処理するアプリケーションにおいて、その効果が大きいと言えます。

GPT-4 Omniの安全性と制限

GPT-4 Omniの安全性と制限

OpenAIのAIモデルと同様、GPT-4 Omniの安全性と制限にも注目が集まっています。記事によると、このモデルにはまだ一部の制限があり、会話の途中で割り込むことがあるほか、ユーザーが話し終わったことを手動で伝える必要があるなどの課題が残されています。これは、GPT-4 Omniの応答速度が向上したにもかかわらず、依然として存在する問題です。

記事はまた、このモデルに組み込まれた安全機能と制限についても触れていますが、その具体的な詳細は示されていません。

全体として、GPT-4 Omniは言語モデルの大きな進歩を示していますが、OpenAIはこの技術の潜在的なリスクと制限について慎重に対応しています。モデルの安全性機能の継続的なモニタリングと改善が、より広範な展開に向けて重要になると考えられます。

GPT-4 Omniの入手可能性とアクセス

GPT-4 Omniの入手可能性とアクセス

OpenAIの最新のフラッグシップモデルであるGPT-4 Omniが広く利用可能になりました。主な詳細は以下の通りです:

- GPT-4 Omniのテキストおよび画像モデルがChatGPTの無料版に統合されたため、すべてのユーザーがこれらの機能にアクセスできるようになりました。

- ChatGPTの無料版のメッセージ制限が5倍に引き上げられ、ユーザーがより利用しやすくなりました。

- 今後数週間以内に、GPT-4 Omni統合の新しい音声モードがリリースされる予定で、音声ベースの対話が可能になります。

- GPT-4 Omniはテキストおよび視覚モデルとしてOpenAI APIで利用可能で、前のGPT-4 Turboモデルと比べて2倍の速度と半分の価格を提供します。

- OpenAIは開発者全員にGPT-4 Omniへの移行を強く推奨しており、GPT-4 Turboモデルにはほとんど使用例がなくなっています。

- GPT-4 Omniの価格設定が大幅に引き下げられ、トークン1,000個あたりの入力コストが$0.005、出力コストが$0.015となり、幅広いアプリケーションで利用しやすくなりました。

要約すると、GPT-4 Omniの利用可能性と利用しやすさが大幅に拡大され、ChatGPTの無料版に統合されるとともに、OpenAI APIでも手頃な価格で提供されるようになりました。これにより、開発者やユーザーにとってより魅力的な選択肢となっています。

GPT-4 Omniによる一貫したキャラクター作成

GPT-4 Omniによる一貫したキャラクター作成

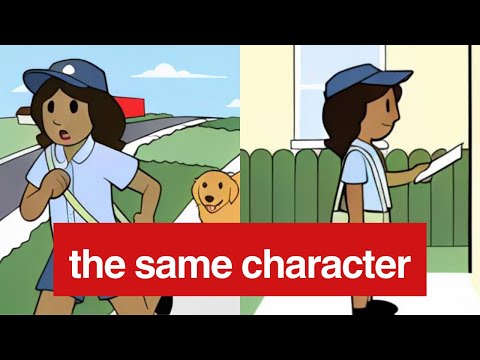

複数のシーンにわたって一貫したキャラクターを作成する能力は、新しいGPT-4 Omniモデルの重要な機能の1つです。視覚的な入力をトレーニングすることで、モデルは服装、アクセサリー、ポーズなどのキャラクター属性を維持しながら、異なるシナリオでキャラクターを描くことができるようになりました。

提示された例では、モデルが「サリー」という郵便配達員のキャラクターを、バッグや制服を一貫して描き出しています。これは前のモデルでは文章による説明に頼らざるを得なかったのに対し、大きな進歩と言えます。

GPT-4 Omniの視覚出力の速度と正確さにより、視覚的なプロンプトに迅速に応答し、適切な視覚的な応答を生成することができます。これにより、一貫したキャラクター表現を必要とする対話型ストーリーテリング、バーチャルアシスタント、ビデオゲーム開発などの新しい可能性が開かれます。

ChatGPTインターフェイス内の例では、モデルの能力を十分に示せていないかもしれませんが、GPT-4 Omniによる一貫したキャラクター作成の可能性は明らかです。開発者はこの機能を活用して、ユーザーにとってより魅力的で没入感のある体験を創出し、マルチモーダルAIシステムの可能性をさらに探求することができます。

結論

結論

OpenAIの新しいGPT-4 Omniモデルは、テキスト、音声、視覚入力を組み合わせてリアルタイムで人間のような対話を実現する、自然言語処理の大きな進歩を示しています。様々なベンチマークでの優れた性能、コストの削減、アクセシビリティの向上により、開発者やユーザーにとって魅力的な選択肢となっています。

しかし、著者がモデルの複数シーンにわたる一貫したキャラクター表現機能を探求した結果、この分野における課題が明らかになりました。発表記事の例では視覚的な詳細を保持できるようですが、ChatGPTインターフェイス内での著者の実験では、その能力が主張ほど堅牢ではないことが示唆されています。

著者がAPIを使ってモデルのキャラクター一貫性をテストすることを提案しているのは適切です。ChatGPTインターフェイスには追加の安全性と制限があり、モデルの性能に影響を及ぼす可能性があるためです。最終的には、この機能の範囲を完全に理解するには、さらなるテストと実験が必要になるでしょう。

全体として、GPT-4 Omniの登場は、マルチモーダルAIの分野における興味深い前進を示しており、著者の洞察は、このモデルの長所と改善の余地を示唆する貴重な視点を提供しています。

FAQ

FAQ